Un equipo de investigadores propone una arquitectura que cambia la forma en que las simulaciones aprenden del mundo físico. ¿Puede la integración de principios fundamentales redefinir los límites de la modelización computacional?

Fuente: ChatGPT

Por: Eugenio Manuel Fernández Aguilar

Físico, escritor y divulgador científico

La inteligencia artificial ha demostrado una capacidad extraordinaria para reconocer patrones en grandes volúmenes de datos. Puede identificar imágenes, anticipar tendencias y generar simulaciones complejas. Sin embargo, cuando se trata de describir cómo evoluciona un sistema físico real a lo largo del tiempo, aparecen límites evidentes. Los modelos pueden ajustarse bien a ejemplos previos, pero pequeñas imprecisiones se amplifican y terminan produciendo resultados físicamente incoherentes. El problema no es la potencia de cálculo, sino la falta de anclaje en leyes fundamentales.

El estudio publicado en Nature Communications aborda esa debilidad desde una perspectiva concreta: incorporar principios físicos directamente en la arquitectura de un modelo de aprendizaje automático. Los autores presentan una red neuronal diseñada para simular sistemas dinámicos complejos sin perder coherencia con reglas básicas de la mecánica. En lugar de confiar únicamente en los datos, el modelo nace condicionado por restricciones físicas. La clave del avance no está en usar más datos, sino en decidir qué reglas deben estar presentes desde el inicio. (Ver cuáles son las leyes más importantes según ChatGPT).

El choque entre modelos clásicos y aprendizaje automático

Los sistemas dinámicos, como el movimiento de partículas, el funcionamiento de engranajes o la marcha humana, evolucionan según leyes precisas. Los modelos clásicos, basados en ecuaciones físicas, siguen esas leyes con rigor. El inconveniente es que cuando el número de elementos crece, el cálculo se vuelve costoso y lento. La precisión matemática puede resultar impracticable en sistemas con miles de interacciones simultáneas.

Por otro lado, las redes neuronales ofrecen flexibilidad y rapidez. En particular, las redes basadas en grafos representan objetos como nodos y sus interacciones como conexiones. Esta estructura permite modelar sistemas con múltiples componentes relacionados. Sin embargo, el propio trabajo reconoce que muchos enfoques actuales “a menudo carecen de consistencia física, interpretabilidad y generalización”. Esto significa que pueden generar predicciones que no respetan principios básicos, especialmente cuando se enfrentan a situaciones nuevas o simulaciones prolongadas. Sin restricciones físicas, el modelo puede desviarse progresivamente de la realidad.

Esta tensión entre rigor físico y adaptabilidad estadística define el contexto en el que surge la propuesta. La pregunta es si es posible combinar ambas aproximaciones sin sacrificar estabilidad ni flexibilidad.

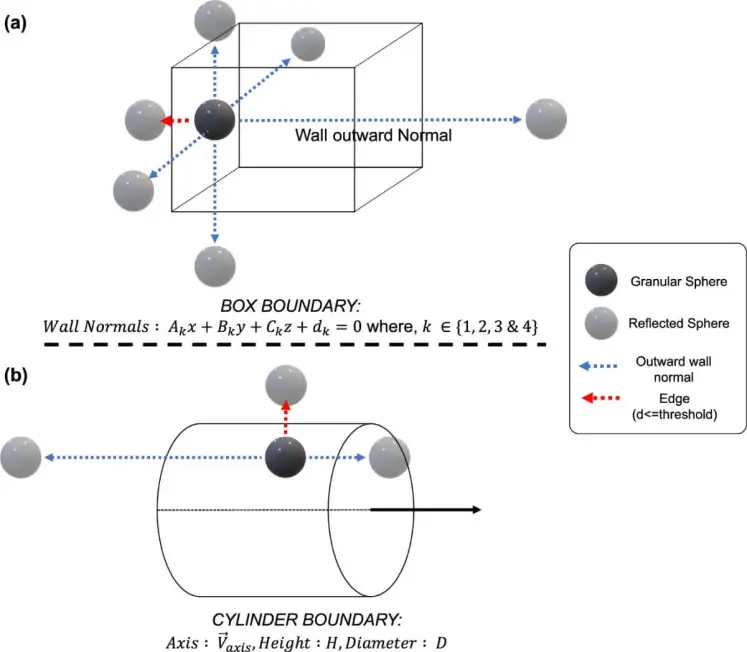

Imagen: Esquema de las condiciones de contorno utilizadas en las simulaciones: arriba, partículas dentro de una caja con normales salientes en cada pared; abajo, sistema granular en un cilindro rotatorio. Las flechas indican la dirección de las fuerzas y las reflexiones en los límites. Fuente: Nature Communications

La tercera ley como fundamento estructural

El modelo desarrollado, denominado Dynami-CAL GraphNet, se describe como “una red neuronal basada en grafos informada por la física que integra las capacidades de aprendizaje de las GNN con sesgos inductivos basados en leyes físicas”. Esta definición resume la estrategia: no se trata solo de aprender a partir de datos, sino de incorporar reglas estructurales que limiten el espacio de soluciones posibles.

La ley elegida como eje es la tercera ley de Newton, que establece que toda acción genera una reacción igual y opuesta. Este principio garantiza la conservación del momento lineal y angular en interacciones internas. En el artículo se afirma que “proponemos un método que integra la conservación del momento lineal y angular directamente en nuestra arquitectura de GNN equivarante al hacer cumplir la tercera ley de Newton a nivel de interacciones internas por pares”. La conservación no se añade después como corrección, sino que forma parte del diseño matemático del modelo.

Esta decisión tiene consecuencias profundas. Cada interacción entre dos elementos del sistema está construida para respetar automáticamente esa simetría. De este modo, el algoritmo evita producir estimaciones de fuerzas incompatibles con la física clásica. La ley actúa como una regla interna que impide soluciones físicamente imposibles.

Estabilidad a largo plazo en simulaciones complejas

Uno de los mayores desafíos en simulación es la acumulación de errores. En modelos puramente estadísticos, pequeñas desviaciones pueden crecer hasta desestabilizar completamente la predicción. El estudio subraya que la arquitectura propuesta logra “una acumulación estable del error en simulaciones prolongadas”. Esta estabilidad no depende de ajustar constantemente el modelo, sino de la coherencia física incorporada desde el inicio.

El texto complementario recoge además que “la mayoría de los otros modelos divergen tras solo unas pocas iteraciones, mientras que Dynami-CAL GraphNet permanece estable durante más de 16.000 pasos consecutivos respetando las leyes de la física”. Mantener consistencia durante miles de pasos temporales es crucial en sistemas donde las interacciones se repiten y se encadenan. La diferencia entre divergir en pocos pasos o mantenerse estable durante miles marca el límite entre una herramienta experimental y una aplicable en entornos reales.

La universalidad de la tercera ley refuerza además la capacidad de extrapolación. Según se explica, esta propiedad permite que el modelo no solo generalice a situaciones similares, sino que produzca predicciones fiables en configuraciones completamente nuevas. El principio físico funciona como una garantía transversal válida a distintas escalas.

Comparación entre entrenamiento y extrapolación: el modelo, entrenado con 60 esferas en una caja estática, predice la dinámica de 2.100 partículas en un cilindro rotatorio manteniendo estabilidad y precisión frente a la simulación de referencia. Fuente: Nature Communications

Pruebas en escenarios reales y diversas escalas

El modelo fue evaluado en sistemas granulares tridimensionales, donde miles de esferas colisionan, ruedan y se rozan dentro de recipientes en movimiento. Tras entrenarse con configuraciones simples, el sistema logró extrapolar a entornos mucho más complejos. La arquitectura no necesitó rediseñarse para manejar un número mucho mayor de partículas.

También se aplicó a la predicción del movimiento humano a partir de datos de captura de movimiento. Sin recibir información explícita sobre fuerzas externas, fue capaz de anticipar la evolución de la marcha. En el ámbito microscópico, se examinó su rendimiento modelando dinámicas moleculares en un entorno líquido. Según se recoge, “predijo con éxito las pequeñas deformaciones que ocurren con el tiempo”. La misma estructura resulta válida desde escalas macroscópicas hasta fenómenos microscópicos.

Otra ventaja destacada es la eficiencia en el entrenamiento. El modelo puede aprender con muy pocos datos y aun así adaptarse a nuevas condiciones operativas o configuraciones más grandes, siempre que las relaciones físicas subyacentes se mantengan. La escasez de datos deja de ser un obstáculo crítico cuando la arquitectura ya incorpora reglas universales.

Transparencia y verificación en sistemas críticos

Además de estabilidad, el modelo aporta interpretabilidad. El texto señala que “todos los cálculos intermedios son consistentes con las leyes de la física”. Esto significa que no actúa como una caja negra que produce resultados inexplicables, sino que calcula magnitudes físicas paso a paso.

El artículo añade que un ingeniero puede comprobar si el sistema respetó la conservación del momento lineal y angular. Esta posibilidad de verificación es esencial cuando las simulaciones influyen en decisiones técnicas sensibles. La confianza en un modelo no depende solo de su precisión, sino de la capacidad de examinar cómo aplica las leyes físicas en cada etapa.

En un momento en que la inteligencia artificial suele asociarse con aproximaciones puramente estadísticas, este trabajo muestra que las leyes clásicas siguen desempeñando un papel central. La física no es sustituida por el algoritmo, sino incorporada como principio rector de su funcionamiento.

Referencias

Vinay Sharma et al., A physics-informed graph neural network conserving linear and angular momentum for dynamical systems, Nature Communications (2026). https://www.nature.com/articles/s41467-025-67802-5.